Phân tích - Bình luận

TPU của Google "so găng" GPU của Nvidia

Google âm thầm phát triển TPU suốt một thập kỷ, và nay công nghệ này đang nổi lên như đối trọng đáng kể trước GPU của Nvidia trong cuộc đua tăng tốc tính toán cho AI.

Google lần đầu giới thiệu bộ xử lý tensor (TPU) cách đây một thập kỷ để tăng tốc công cụ tìm kiếm và nâng cao hiệu quả vận hành. Sau đó, chúng được tùy chỉnh để xử lý các tác vụ học máy trong các ứng dụng AI của Google.

Gần đây, công ty liên tục ký được những hợp đồng lớn, cho thấy TPU đang trở thành phương án thay thế khả thi cho các bộ tăng tốc AI của Nvidia — vốn được biết đến rộng rãi dưới tên gọi GPU (graphics processing unit).

GPU và TPU khác nhau thế nào?

Cả GPU và TPU đều được thiết kế để xử lý khối lượng tính toán khổng lồ trong quá trình huấn luyện mô hình AI. Tuy nhiên, kiến trúc và cách hoạt động của chúng khác nhau. GPU của Nvidia ban đầu được phát triển để dựng hình game, nên có khả năng xử lý song song hàng nghìn tác vụ thông qua cấu trúc gồm vô số lõi. Chính kiến trúc này giúp GPU thực hiện các tác vụ AI ở tốc độ mà các công nghệ khác khó bì kịp.

Ngược lại, TPU được thiết kế chuyên biệt cho phép toán nhân ma trận — dạng tính toán cốt lõi trong việc huấn luyện mạng nơ-ron, giúp AI tạo ra phản hồi cho các mô hình như ChatGPT của OpenAI hay Claude của Anthropic. Những phép tính này mang tính lặp lại và tuần tự hơn là song song. TPU vì thế tối ưu cho hiệu quả năng lượng và tốc độ ở nhóm tác vụ này, nhưng lại kém linh hoạt hơn GPU. GPU đa dụng và lập trình được nhiều kiểu tác vụ hơn, bù lại vận hành tốn chi phí và năng lượng hơn.

Google bắt đầu phát triển TPU từ năm 2013 và tung ra phiên bản đầu tiên hai năm sau đó. Ban đầu, TPU chỉ phục vụ nội bộ để tăng tốc tìm kiếm và tiết kiệm chi phí vận hành. Đến năm 2018, Google bắt đầu đưa TPU lên nền tảng đám mây, cho phép khách hàng sử dụng chính công nghệ từng được dùng để chạy công cụ tìm kiếm.

Song song với đó, TPU cũng được điều chỉnh để phục vụ hoạt động phát triển AI nội bộ. Khi Google và DeepMind xây dựng các mô hình hiện đại như Gemini, kinh nghiệm từ đội AI tiếp tục quay trở lại đội thiết kế chip, giúp tối ưu TPU theo đúng nhu cầu thực tế của các mô hình mới.

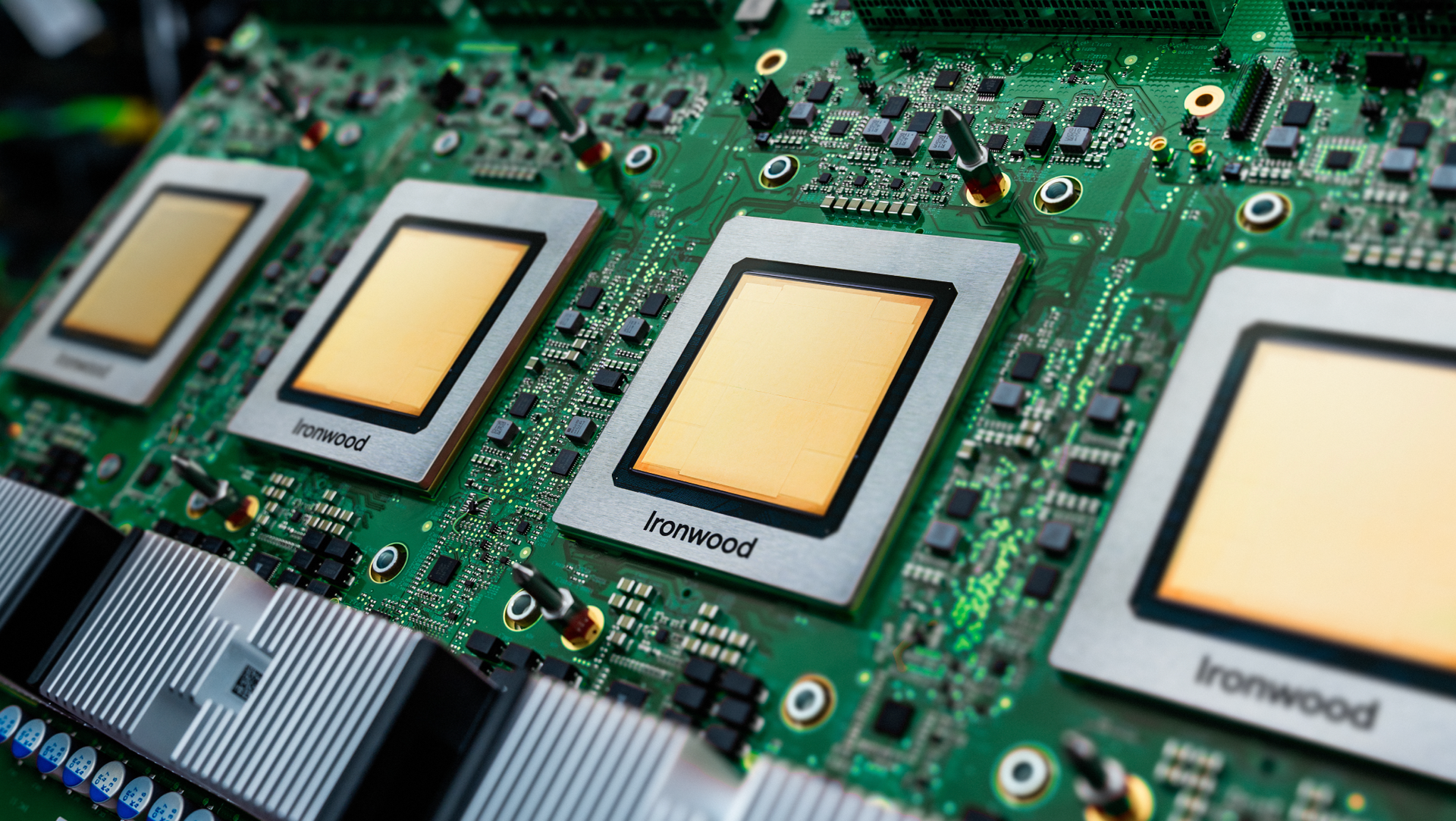

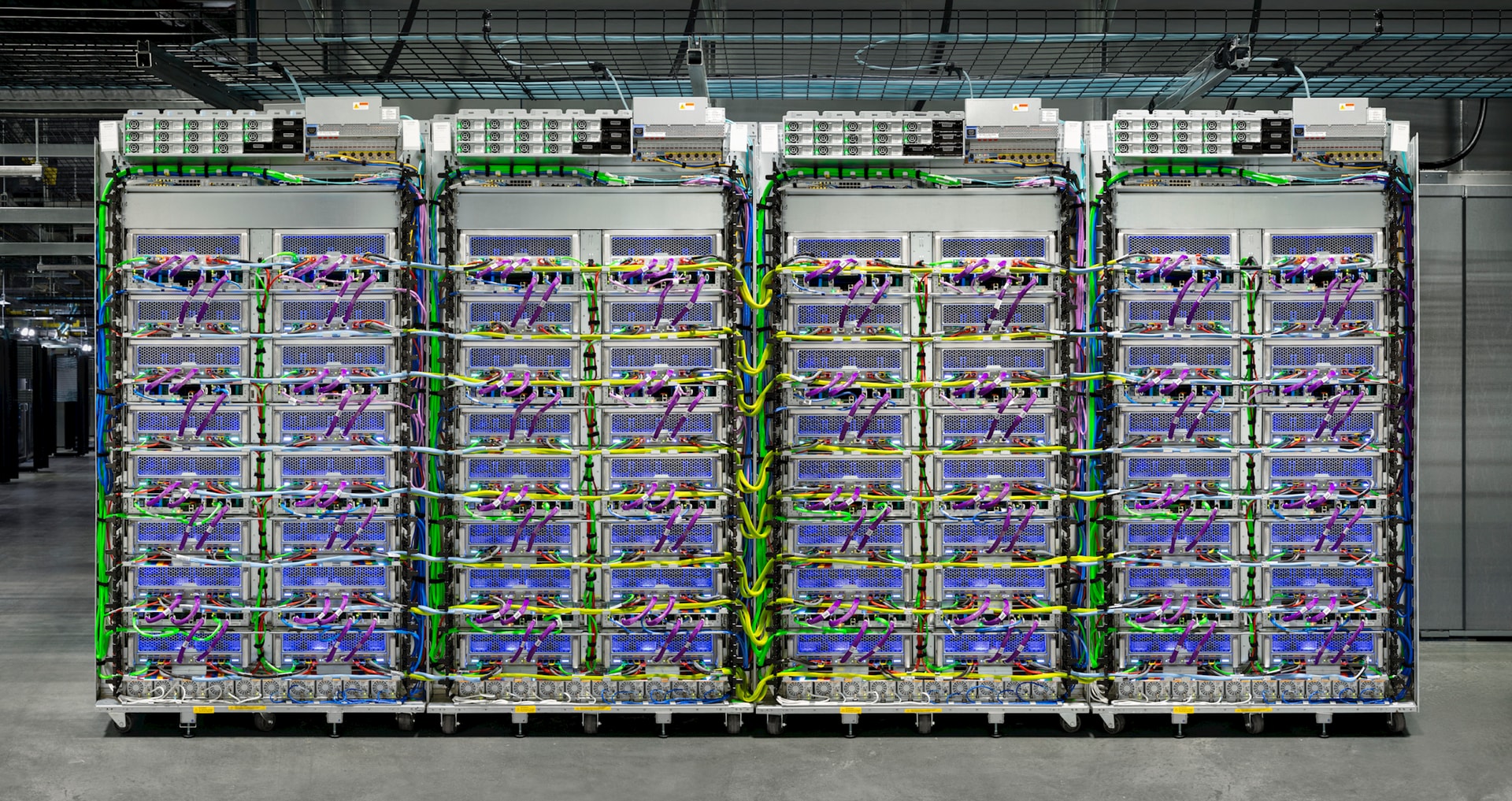

Phiên bản mới nhất, TPU Ironwood, ra mắt tháng 4 vừa qua. Chip được làm mát bằng chất lỏng, tối ưu cho xử lý “suy luận” — tức vận hành mô hình AI thay vì huấn luyện. Ironwood có hai cấu hình: cụm 256 chip và cụm lớn tới 9.216 chip.

Các chuyên gia đánh giá TPU có thể vượt GPU trong một số tác vụ, một phần vì Google có thể “lược bỏ những phần không cần thiết đối với AI”, giúp chip mạnh hơn và ít tiêu tốn năng lượng hơn sau bảy thế hệ cải tiến.

Triển vọng thị trường TPU

Nhiều tên tuổi lớn trong lĩnh vực AI đã bắt đầu sử dụng TPU của Google. Trong danh sách khách hàng có Safe Superintelligence — công ty do đồng sáng lập OpenAI Ilya Sutskever lập nên, cùng với Salesforce và Midjourney. Anthropic, đối tác AI lớn của Google, đã ký thỏa thuận sử dụng tới 1 triệu TPU, tương đương hơn 1 gigawatt năng lực tính toán.

The Information cho biết Meta cũng đang thảo luận để sử dụng TPU vào năm 2027. Những động thái này phản ánh nhu cầu cấp thiết về khả năng tính toán, trong bối cảnh các mô hình AI ngày càng lớn và phức tạp.

Các nhà phát triển AI hàng đầu đang chi hàng chục tỷ USD để mua chip Nvidia, đồng thời muốn giảm phụ thuộc cũng như tránh rủi ro thiếu hụt nguồn cung. Điều này mở ra thị trường lớn cho TPU.

Hiện tại, doanh nghiệp muốn sử dụng TPU phải thuê thông qua dịch vụ đám mây của Google. Tuy nhiên, thỏa thuận mới với Anthropic được xem là tín hiệu cho khả năng Google mở rộng TPU sang các nền tảng đám mây khác.

Dù vậy, không ai — kể cả Google — có ý định thay thế hoàn toàn GPU của Nvidia. Tốc độ phát triển AI quá nhanh khiến GPU vẫn là lựa chọn bắt buộc cho nhiều loại mô hình. Google vẫn là khách hàng lớn của Nvidia vì cần duy trì tính linh hoạt cho khách hàng. Theo Gartner, nếu thuật toán hoặc mô hình thay đổi, GPU vẫn phù hợp hơn vì chúng xử lý đa dạng tác vụ tốt hơn.

Ngay cả các công ty đang đầu tư mạnh vào TPU cũng tiếp tục chi lớn cho GPU. Anthropic ký thỏa thuận lớn với Nvidia chỉ vài tuần sau khi hợp tác với Google. Triển vọng thực tế nhất của TPU là trở thành một phần trong nhóm giải pháp tính toán cần thiết để vận hành ngành AI đang bùng nổ.