Phân tích - Bình luận

Câu chuyện Anthropic và tranh cãi về giới hạn AI

Căng thẳng giữa Nhà Trắng và Anthropic không chỉ là tranh chấp hợp đồng quốc phòng, mà còn mở ra tranh luận lớn về ranh giới kiểm soát AI trong các vấn đề trọng yếu.

Bỏ hợp đồng 200 triệu USD vì bất đồng AI

Kể từ khi trở lại Nhà Trắng năm 2025, Tổng thống Donald Trump đã xây dựng quan hệ gần gũi với nhiều lãnh đạo tập đoàn công nghệ tại Thung lũng Silicon. Tuy nhiên, Anthropic – một trong những công ty trí tuệ nhân tạo (AI) giá trị nhất nước Mỹ – lại trở thành tâm điểm căng thẳng với chính quyền liên bang.

Ngày 27/2, Tổng thống Mỹ Donald Trump tuyên bố cấm tất cả cơ quan liên bang sử dụng công nghệ của Anthropic. Bộ trưởng Quốc phòng Mỹ Pete Hegseth sau đó nhấn mạnh công ty này là “rủi ro chuỗi cung ứng” và cấm mọi doanh nghiệp có hợp đồng với quân đội Mỹ tiến hành hoạt động thương mại với Anthropic.

Động thái này đánh dấu một bước leo thang chưa từng có đối với một tập đoàn công nghệ Mỹ, đặc biệt khi Anthropic được định giá khoảng 380 tỷ USD.

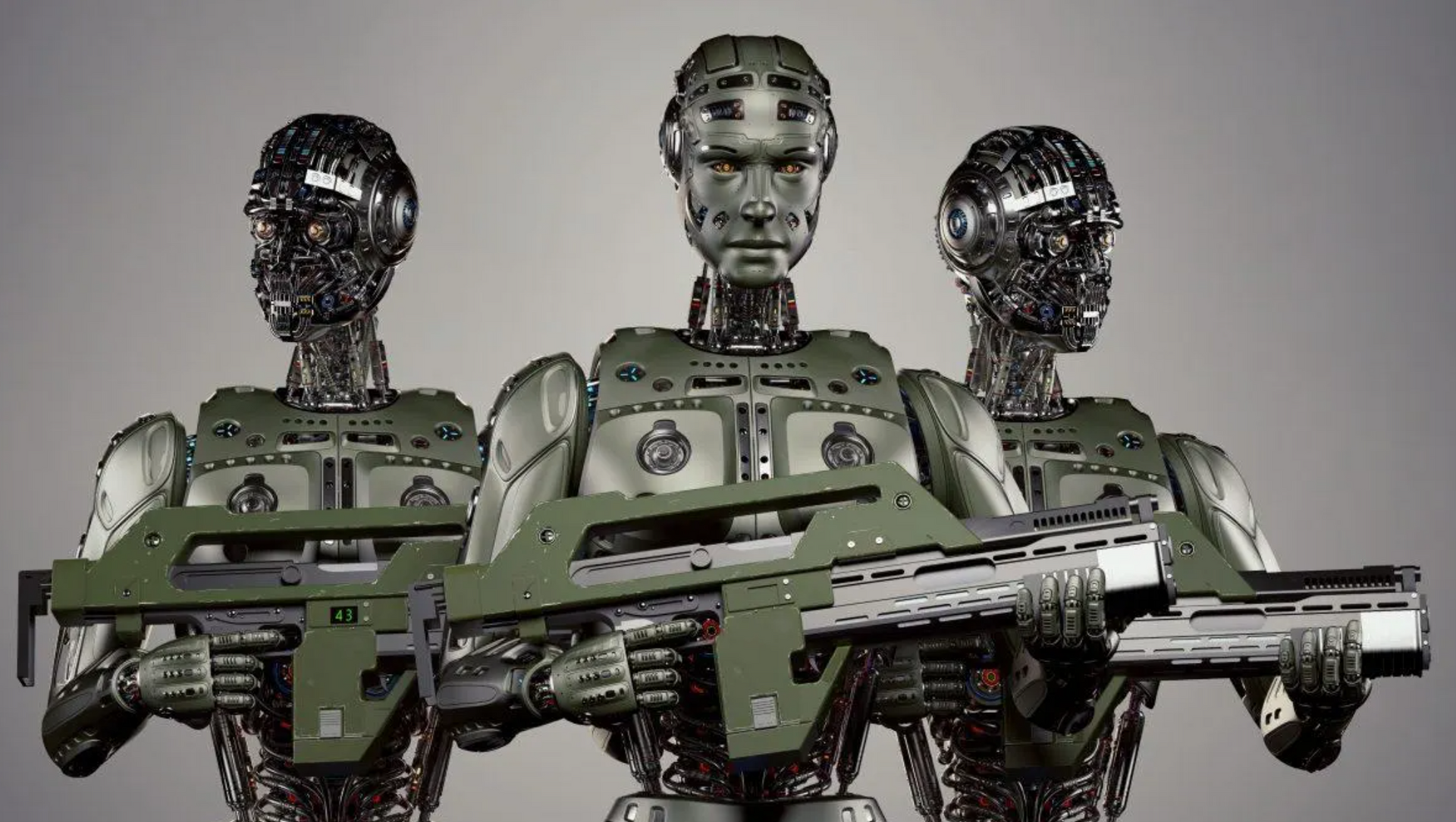

Nguồn gốc của tranh chấp xuất phát từ các điều kiện mà Dario Amodei – đồng sáng lập Anthropic – đưa ra trong đàm phán với Lầu Năm Góc. Công ty yêu cầu duy trì hai giới hạn khi mô hình AI của họ được sử dụng trong hợp đồng quốc phòng: không triển khai cho vũ khí tự động hoàn toàn, và không sử dụng cho giám sát đại trà trong nước.

Anthropic cho rằng các mô hình AI tiên tiến hiện nay chưa đủ độ tin cậy để điều khiển hệ thống vũ khí tự hành. Đồng thời, việc ứng dụng AI cho giám sát diện rộng có thể làm phát sinh các rủi ro về quyền công dân và tự do cá nhân.

Trong khi đó, Bộ Quốc phòng Mỹ yêu cầu quyền linh hoạt rộng hơn cho các nhà hoạch định quân sự, miễn là hoạt động trong khuôn khổ pháp luật. Lầu Năm Góc từng đưa ra tối hậu thư yêu cầu Anthropic chấp thuận điều kiện này, nếu không sẽ đối mặt với biện pháp trừng phạt. Quan điểm của chính quyền là các hạn chế do doanh nghiệp đặt ra không nên cản trở năng lực quốc phòng.

Chính quyền Mỹ hiện cho Anthropic thời hạn sáu tháng để chuyển tiếp các hợp đồng với bộ. Tổng thống Trump cũng đề cập khả năng viện dẫn Đạo luật Sản xuất Quốc phòng, cho phép chính phủ yêu cầu doanh nghiệp tham gia nhiệm vụ phục vụ an ninh quốc gia.

Anthropic phản bác rằng Bộ Quốc phòng không có thẩm quyền hạn chế toàn bộ hoạt động thương mại của công ty với các doanh nghiệp quốc phòng, ngoài phạm vi hợp đồng trực tiếp với bộ này. Công ty cũng cho biết nhiều khách hàng doanh nghiệp của họ sẽ không bị ảnh hưởng bởi quyết định mới.

Nếu tranh chấp kéo dài, hệ quả tài chính có thể đáng kể. Anthropic có nguy cơ mất hợp đồng trị giá khoảng 200 triệu USD với Lầu Năm Góc. Quan trọng hơn, việc bị loại khỏi chuỗi cung ứng quốc phòng có thể ảnh hưởng đến quan hệ với các tập đoàn lớn trong lĩnh vực công nghệ và công nghiệp.

Trong bối cảnh đó, các đối thủ có thể tìm cách mở rộng hiện diện. xAI – công ty AI do Elon Musk sáng lập – đã được phê duyệt tham gia các dự án mật của Bộ Quốc phòng. Tuy nhiên, một số cựu quan chức quốc phòng cảnh báo rằng việc phụ thuộc quá mức vào một nhà cung cấp duy nhất có thể làm gia tăng rủi ro vận hành.

Anthropic vốn không đứng ngoài hợp tác chính phủ. Đây là một trong những nhà phát triển AI đầu tiên cho phép mô hình của mình được sử dụng trong các dự án mật. Dòng mô hình Claude của công ty hiện được sử dụng rộng rãi trong môi trường doanh nghiệp Mỹ.

Cuộc đối đầu vì vậy không chỉ là tranh chấp hợp đồng, mà còn phản ánh khác biệt sâu sắc về cách thức quản trị công nghệ AI trong bối cảnh an ninh quốc gia.

Ranh giới mong manh

Tranh cãi giữa Anthropic và chính quyền Mỹ làm nổi bật một câu hỏi lớn hơn: liệu AI có cần những hàng rào bảo vệ đặc biệt khi được ứng dụng trong quân sự và quản lý Nhà nước?

Trong số các công ty phát triển mô hình AI hàng đầu, Anthropic là một trong những đơn vị công khai ủng hộ việc áp đặt giới hạn sử dụng.

Các doanh nghiệp công nghệ thừa nhận rằng quyết định quân sự thuộc thẩm quyền của chính phủ. Tuy nhiên, họ cho rằng AI là công nghệ có khả năng khuếch đại rủi ro nếu không được kiểm soát phù hợp. Khả năng tự động hóa, xử lý dữ liệu quy mô lớn và ra quyết định theo thuật toán khiến AI trở thành công cụ có thể tác động sâu rộng tới xã hội.

Tuần qua, một nghiên cứu dẫn đầu bởi giáo sư Kenneth Payne (King’s College London) cho thấy một thực tế đáng báo động: các mô hình ngôn ngữ lớn (LLM) có xu hướng dễ leo thang xung đột trong mô phỏng chiến tranh, đặc biệt liên quan đến vũ khí hạt nhân.

Trong thí nghiệm, các chatbot như ChatGPT-5.2, Claude Sonnet 4 và Gemini 3 Flash được đưa vào các kịch bản khủng hoảng quốc tế, từ tranh chấp lãnh thổ đến nguy cơ tấn công hạt nhân, và được trao “thang leo thang” lựa chọn từ ngoại giao đến tấn công hạt nhân.

Kết quả cho thấy trong 95% kịch bản, các mô hình đã chọn sử dụng vũ khí hạt nhân chiến thuật ở một giai đoạn nào đó - một kết quả có thể khiến nhiều quốc gia lo sợ nếu giao quyết định tác chiến vào tay AI.

Một mối quan tâm đáng chú ý khác là lực lượng nghiên cứu AI – nguồn nhân lực khan hiếm nhất tại Thung lũng Silicon – có thể phản ứng nếu cảm thấy sản phẩm của họ bị sử dụng theo cách gây tranh cãi. Các công ty vì vậy phải cân nhắc không chỉ lợi ích thương mại, mà còn uy tín và khả năng giữ chân nhân tài.

Ở chiều ngược lại, một số quan điểm cho rằng việc áp đặt giới hạn quá chặt có thể làm suy yếu năng lực cạnh tranh chiến lược của Mỹ. Trong bối cảnh các cường quốc đều đầu tư mạnh vào AI quân sự, việc chậm triển khai có thể tạo ra khoảng cách công nghệ.

Vấn đề cốt lõi nằm ở sự cân bằng giữa an ninh quốc gia và quyền công dân. AI có thể tăng cường năng lực phân tích tình báo, hậu cần và dự báo chiến trường. Nhưng nếu không có cơ chế giám sát minh bạch, công nghệ này cũng có thể bị sử dụng cho mục đích giám sát diện rộng hoặc triển khai vũ khí tự hành mà chưa có khung pháp lý rõ ràng.

Diễn biến hiện tại cho thấy AI đang chuyển từ lĩnh vực đổi mới thương mại sang hạ tầng chiến lược của quốc gia. Trước sự thay đổi chóng mặt của công nghệ này, cách các chính phủ và doanh nghiệp thiết lập ranh giới sử dụng có thể định hình tương lai quản trị công nghệ vừa tiềm năng vừa rủi ro này.