DynamoFL là một trong những công ty khởi nghiệp cung cấp phần mềm mang các mô hình ngôn ngữ lớn (LLM) đến các doanh nghiệp và tinh chỉnh các mô hình đó trên dữ liệu nhạy cảm.

>>AHG Lab huy động vốn để hỗ trợ các doanh nghiệp khởi nghiệp

Các nhà sáng lập DynamoFL

DynamoFL đã huy động thành công 15,1 triệu USD trong vòng cấp vốn Series A do Canapi Ventures và Nexus Venture Partners đồng dẫn đầu. Với sự tham gia của Formus Capital và Soma Capital, nâng tổng số tiền huy động được của startup này lên 19,3 triệu USD.

Được thành lập năm 2021, DynamoFL có trụ sở tại San Francisco được sáng lập bởi Mugunthan và Christian Lau, cả hai đều tốt nghiệp Khoa Kỹ thuật Điện và Khoa học Máy tính của MIT. Ý tưởng sáng lập của họ với mong muốn chung là giải quyết các lỗ hổng bảo mật dữ liệu “quan trọng” trong các mô hình AI.

Theo Vaikkunth Mugunthan, đồng sáng lập kiêm Giám đốc điều hành của DynamoFL chia sẻ, AI đã mang đến cho doanh nghiệp sử dụng một số rủi ro trong đó có khả năng LLM “ghi nhớ” dữ liệu nhạy cảm khi dữ liệu này bị rò rỉ sẽ bị ảnh hưởng bởi các tác nhân độc hại.

>>Quản trị phải có phải là trung tâm của khởi nghiệp?

"Nếu các doanh nghiệp cần được trang bị đầy đủ để giải quyết những rủi ro này, để giải quyết đúng cách các lỗ hổng LLM doanh nghiệp buộc phải tuyển dụng các nhóm các nhà nghiên cứu máy đọc về quyền riêng tư có chuyên môn cao để tạo ra cơ sở hạ tầng hợp và liên tục kiểm tra LLM trước các lỗ hổng bảo mật dữ liệu mới", ông Mugunthan lưu ý.

Với nguồn vốn mới DynamoFL lên kế hoạch mở rộng các sản phẩm mới và phát triển đội ngũ các nhà nghiên cứu quyền riêng tư

Hiện nay, các doanh nghiệp chắc chắn đang gặp phải những thách thức, chủ yếu liên quan đến tuân thủ trong việc áp dụng LLM cho mục đích của họ. Các công ty lo lắng về dữ liệu bí mật của họ sẽ đến tay các nhà phát triển, những người đã đào tạo các mô hình về dữ liệu người dùng. Thời gian gần đây, các tập đoàn lớn bao gồm Apple, Walmart và Verizon đã cấm nhân viên sử dụng các công cụ như ChatGPT của OpenAI.

Các doanh nghiệp đều lo ngại về dữ liệu bí mật của họ sẽ đến tay các nhà phát triển

DynamoFL, được triển khai trên đám mây riêng của khách hàng hoặc tại chỗ, cố gắng giải quyết những vấn đề này theo nhiều cách, bao gồm cả việc sử dụng công cụ kiểm tra thâm nhập LLM để phát hiện và ghi lại các rủi ro bảo mật dữ liệu LLM như LLM đã ghi nhớ hay chưa có thể rò rỉ dữ liệu nhạy cảm.

Một số nghiên cứu đã chỉ ra rằng các LLM, tùy thuộc vào cách họ được đào tạo và nhắc nhở, có thể tiết lộ thông tin cá nhân. Đây là một sự nguy hiểm rõ ràng đối với các công ty lớn làm việc với dữ liệu độc quyền.

Bên cạnh đó, DynamoFL còn cung cấp nền tảng phát triển LLM kết hợp các kỹ thuật nhằm giảm thiểu rủi ro rò rỉ dữ liệu mô hình và các lỗ hổng bảo mật. Sử dụng nền tảng này, các nhà phát triển có thể tích hợp các tối ưu hóa khác nhau vào các mô hình, đồng thời cho phép chúng chạy trên các môi trường bị hạn chế về phần cứng như thiết bị di động và máy chủ biên.

>>Công ty khởi nghiệp Pollen phát triển nền tảng nâng cao kỹ năng cho nhân viên công nghệ

Mặc dù ngày nay có các sản phẩm để sắp xếp lại thông tin nhận dạng cá nhân từ các truy vấn được gửi đến các dịch vụ LLM, nhưng những sản phẩm này không đáp ứng các yêu cầu quy định nghiêm ngặt trong các lĩnh vực như dịch vụ tài chính và bảo hiểm, nơi thông tin nhận dạng cá nhân được sắp xếp lại thường được xác định lại thông qua các cuộc tấn công độc hại tinh vi.

Dựa trên chuyên môn về các lỗ hổng bảo mật AI, DynamoFL xây dựng giải pháp toàn diện nhất cho các doanh nghiệp đang tìm cách đáp ứng các yêu cầu quy định về bảo mật dữ liệu LLM.

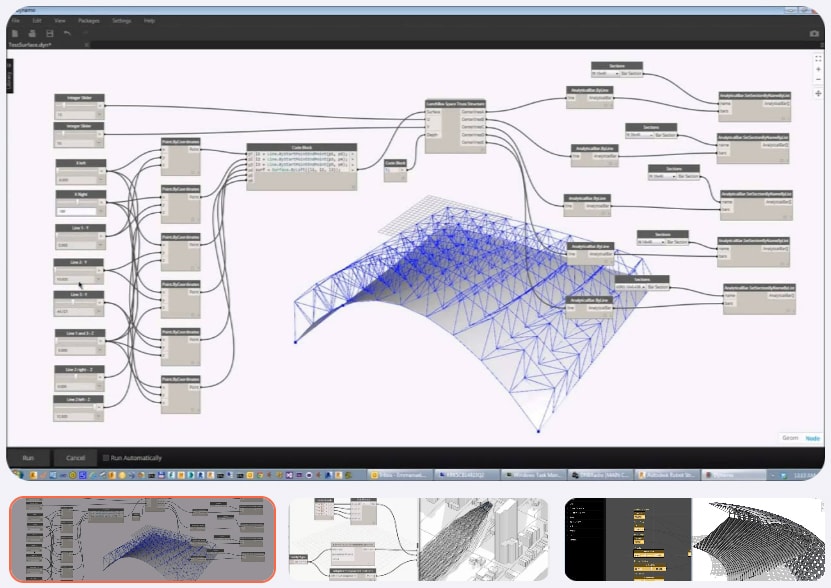

Dynamo Studio là một thành phần có một không hai của chương trình cho phép các kiến trúc sư và nhà thiết kế đánh giá các đặc tính âm học của một tòa nhà hoặc căn phòng tiềm năng. Khi các kiến trúc sư có quyền truy cập vào các phân tích và hiểu biết sâu rộng về dữ liệu chính, họ có thể tạo ra các thiết kế phức tạp hơn.

Có thể bạn quan tâm

Startup 11xAI xây dựng các công nhân kỹ thuật số (AI) có thể thay thế người lao động

01:01, 15/08/2023

Chiến lược tăng trưởng của startup Tracer chậm mà chắc khi gọi vốn “ngủ đông”

11:22, 13/08/2023

Startup One Model phát triển nền tảng thu thập và áp dụng dữ liệu về tổ chức và nhân tài

02:52, 08/08/2023