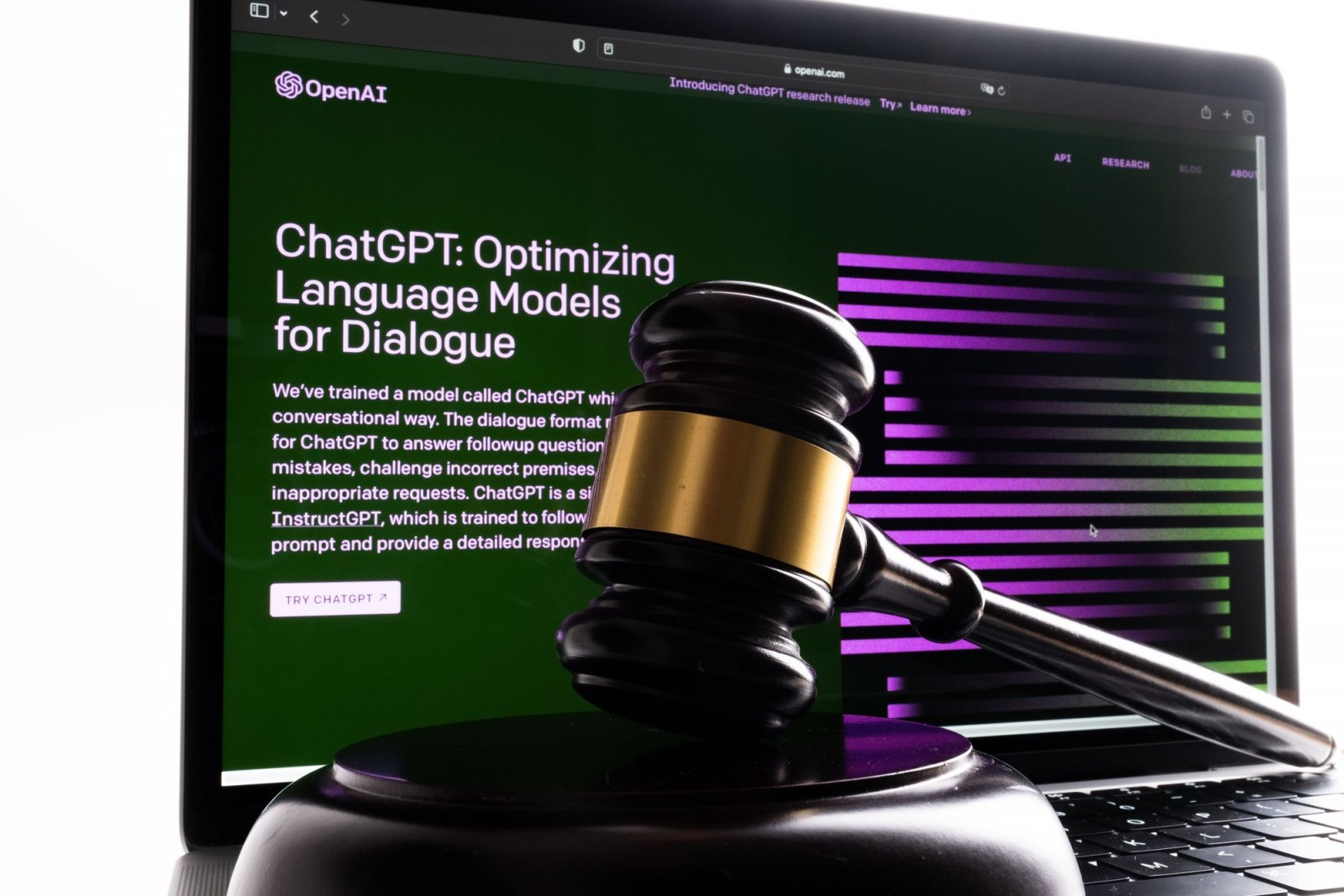

Từ khi ChatGPT được biết đến tháng 11/2023, AI tạo sinh vẫn đang “gây bão” trên toàn thế giới. Với sự phát triển mạnh mẽ của AI, chính phủ các nước chuẩn bị ban hành những luật quản lý công nghệ này.

>>Trung Quốc tăng cường quản lý AI tạo sinh

Từ Mỹ, EU cho đến Brazil hay Trung Quốc, các nhà lập pháp đang khẩn trương chuẩn bị các quy định quản lý AI.

Động thái của châu Âu

Ủy ban Châu Âu, bao gồm khoảng hai mươi quốc gia, đang đàm phán giai đoạn cuối về Đạo luật AI , đây là “các quy tắc đầu tiên trên thế giới về AI”. Dự kiến phiên bản hoàn chỉnh của Đạo luật AI sẽ được thống nhất trong năm nay, và có thể sẽ có hiệu lực vào cuối năm 2025.

Đạo luật AI của Uỷ Ban châu Âu được đề xuất lần đầu tiên vào năm 2021, trước cả khi OpenAI phát hành ChatGPT và DALL-E. Năm nay, dự thảo luật của EU tiếp tục cập nhật với mục đích chủ yếu nhằm phân loại các sản phẩm AI có nguy cơ cao hoặc không được chấp nhận, ví dụ như các công cụ nhận dạng sinh trắc học, giáo dục, quản lý nhân sự, hệ thống quản lý và thực thi pháp luật, và bất kỳ sản phẩm mới nào cũng phải được kiểm tra và phê duyệt trước khi ra mắt.

Theo đạo luật này, các công cụ AI "không được chấp nhận" sẽ bị cấm ở EU, bao gồm "hệ thống nhận dạng sinh trắc học từ xa" hoặc công nghệ nhận dạng khuôn mặt; "chấm điểm tầng lớp xã hội" hoặc phân loại con người dựa trên giai cấp kinh tế và đặc điểm cá nhân; và "thao túng hành vi nhận thức", chẳng hạn như đồ chơi hỗ trợ AI kích hoạt bằng giọng nói.

Theo các quy tắc đề xuất của EU, mọi sản phẩm dùng công nghệ AI đều bắt buộc phải khai báo rõ những nội dung nào sẽ được nhân bản, toàn bộ dữ liệu đào tạo bất kì một mô hình AI đa ngôn ngữ nào cũng phải được tiết lộ để kiểm duyệt.

Thông thường dữ liệu đào tạo AI thường được thu thập từ những tác giả khác nhau trên Internet, tạo nên một bộ dữ liệu khổng lồ đề “dạy” cho AI. Tuy nhiên, do phản ứng từ cộng đồng các tác giả và nhà sáng tạo nội dung, các công ty đứng sau AI và LLM dần bắt đầu không ghi rõ nguồn dữ liệu đào tạo AI đến từ đâu.

Với đạo luật này, các công ty cần phải chuẩn bị để tránh những kiện tụng pháp lý về bản quyền sau này, đồng thời phải đăng ký tất cả sản phẩm trên cơ sở dữ liệu của Uỷ ban Châu Âu.

Định hướng của Mỹ

Sau EU, Mỹ cũng tiếp bước trong việc quản lý AI. Tháng Chín vừa qua, Nhà Trắng cho biết họ đang “phát triển quy định hành pháp” về công nghệ AI và sẽ tuân thủ hệ thống Hai đảng của nước này.

Hiện Nhà Trắng đang tham vấn với các chuyên gia trong ngành, còn Thượng viện thì đã triệu tập một phiên điều trần, giống như một "diễn đàn AI" kín với lãnh đạo “ông lớn công nghệ”. Tại diễn đàn, Mark Zuckerberg đã bị chất vấn về việc mô hình Llama 2 của Meta đã đưa ra hướng dẫn chi tiết để tạo ra bệnh than.

Tạm thời chính phủ Mỹ chưa chính thức đưa ra hành động cụ thể, nhưng các nhà lập pháp cam kết sẽ có luật quản lý AI. Thượng nghị sĩ Richard Blumenthal nói trong phiên điều trần: “Đừng hiểu nhầm, sẽ có luật.”

Luật Bản quyền của Hoa Kỳ cũng có thể thay đổi. Tháng Tám vừa qua, Văn phòng Bản quyền cho biết họ đang xem xét các quy định liên bang xung quanh AI vì hiện đang có nhiều “cuộc tranh cãi rộng rãi về tác động của nó đối với tương lai của các ngành công nghiệp sáng tạo”. Năm ngoái, Văn phòng Bản Quyền Mỹ đã mở một khu vực bình luận công khai cho đến tháng 11 và nhận về hơn 7.500 lượt.

Tình hình tại Anh

Khác với châu Âu lục địa, tại Anh, với truyền thống Tiền lệ Pháp (Common Law) của mình, chính phủ khá “cởi mở” với AI và chưa có ý định đưa ra luật nào để quản lý công nghệ này. Chính phủ muốn tạo không gian để AI phát triển trước, rồi sẽ điều chỉnh quy định sau.

Theo một bài báo hồi tháng 3 của Bộ Khoa học, Đổi mới và Công nghệ của nước này, Anh mong muốn trở thành một “siêu cường AI”. Do đó, chính phủ Anh cho rằng áp đặt luật quá sớm sẽ kìm hãm sự phát triển của doanh nghiệp.

Michelle Donelan, Bộ trưởng Bộ Khoa học, Đổi mới và Công nghệ, cho biết: “Bằng cách vội vã ban hành luật quá sớm, chúng tôi có nguy cơ đặt gánh nặng quá mức lên các doanh nghiệp”. “Khi công nghệ phát triển, cách tiếp cận quy định của chúng tôi cũng có thể cần phải điều chỉnh.”

Brazil và Trung Quốc

Giống với EU, Brazil đang cập nhật dự thảo luật về AI, theo đó họ sẽ phân loại AI theo mức độ rủi ro “cao” hoặc “nguy hiểm”, và sẽ hoàn toàn cấm các sản phẩm nguy hiểm.

Luật Brazil được soạn thảo sau khi được công ty tư vấn công nghệ Access Partnership hỗ trợ, trên cơ sở đảm bảo “nhân quyền” và quy định "chế độ trách nhiệm pháp lý nghiêm ngặt" cho các doanh nghiệp. Theo luật của Brazil, LLM phải chịu trách nhiệm về tác hại do bất kỳ hệ thống AI nào có rủi ro cao gây ra.

Với Trung Quốc, các quy định mới, khá nghiêm ngặt về AI đã chính thức ban hành. Tuy việc sử dụng nhận dạng khuôn mặt rất phổ biến tại quốc gia này, nhưng trong hai năm lại đây, Trung Quốc đã ban hành các quy định chặt chẽ về thuật toán đề xuất nhằm tránh tình trạng giả mạo tinh vi. Đáng nói là thuật toán đề xuất chính là yếu tố cốt lõi của AI.

Luật nước này quy định dữ liệu đào tạo cho AI phải “đúng và chính xác.” Chỉ với điều luật này là đã đủ để AI không dám “bén mảng” đến Trung Quốc nữa. Tổ chức Hòa bình Quốc tế Carnegie, một tổ chức tư vấn phi đảng phái, đánh giá rằng các quy định của phía Trung Quốc là "một rào cản không thể vượt qua đối với các chatbot AI".

Có thể bạn quan tâm